29/05/2021 (2021-05-29)

Par Jean-Michel Grau

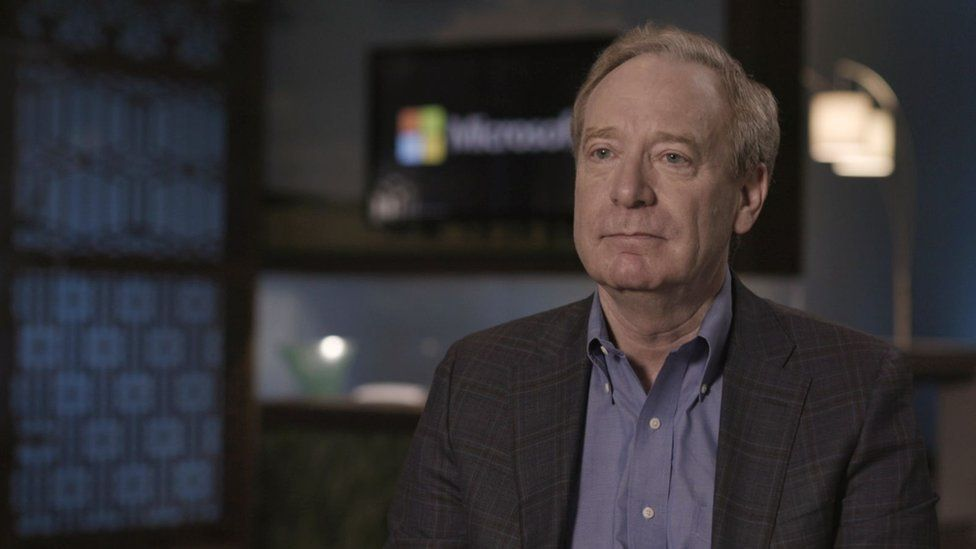

La vie telle que décrite dans le roman 1984 de George Orwell « pourrait se réaliser en 2024 » si les législateurs ne protègent pas le public contre l’intelligence artificielle, a averti le président de Microsoft.(([1] bbc.com/news/technology-57122120))

S’exprimant dans l’émission Panorama de la BBC, Brad Smith a déclaré qu’il sera « difficile de rattraper » la technologie qui progresse rapidement.

L’émission a exploré l’utilisation croissante de l’IA par la Chine pour surveiller ses citoyens.

Les critiques craignent que la domination de l’État dans ce domaine ne menace la démocratie.

« Si nous ne promulguons pas les lois qui protégeront le public à l’avenir, nous allons constater que la technologie avance à toute allure, et il sera très difficile de la rattraper », a déclaré M. Smith.

« Je me souviens constamment des leçons de George Orwell dans son livre 1984. Vous savez que l’histoire fondamentale était celle d’un gouvernement qui pouvait voir tout ce que chacun faisait et entendre tout ce que chacun disait, tout le temps. Eh bien, cela ne s’est pas produit en 1984, mais si nous ne faisons pas attention, cela pourrait se produire en 2024. »

« Dans certaines parties du monde, la réalité rattrape de plus en plus cette vision de la science-fiction », a-t-il ajouté.

L’intelligence artificielle chinoise

L’ambition de la Chine est de devenir le leader mondial de l’IA d’ici 2030, et beaucoup considèrent que ses capacités sont bien supérieures à celles de l’UE.

En 2019, la Chine a battu les États-Unis au niveau du nombre de brevets obtenus par les institutions universitaires pour l’innovation dans les technologies d’IA.

54 % des 770 millions de caméras de vidéosurveillance dans le monde se trouvent en Chine, selon une étude de Comparitech.

L’émission a donné aussi l’occasion d’entendre Eric Schmidt, ancien directeur général de Google et actuel président de la Commission de sécurité nationale américaine sur l’intelligence artificielle.

Celui-ci a prévenu qu’il était impératif de battre la Chine en matière d’IA :

« Nous sommes dans un conflit stratégique géopolitique avec la Chine », a-t-il déclaré.

« Le moyen de gagner est de rassembler toutes nos ressources afin de mettre en place des stratégies nationales et mondiales permettant aux démocraties de gagner dans le domaine de l’IA. Si nous ne le faisons pas, nous serons confrontés à un avenir où d’autres valeurs nous seront imposées. »

Le Dr Lan Xue, qui conseille le gouvernement chinois, invité aussi de l’émission, a déclaré que la reconnaissance faciale pourrait se révéler « extrêmement utile » pour identifier les personnes dans les rassemblements de masse « en cas d’accident majeur. »

« La Chine a en effet fait d’énormes progrès en matière de développement technologique », a ajouté le Dr Xue. « Les États-Unis ressentent cela comme une menace et ils ont voulu lancer cette guerre froide sur la technologie. »

« Bien que la Chine ait des différences énormes dans ses valeurs et sa politique, la vision du monde de ce pays n’est pas la convergence, mais la coexistence. La Chine ne cherche pas à exporter ses valeurs », a déclaré le Dr Keyu Jin, professeur associé à la London School of Economics.

Le projet Maven

Le Dr Schmidt est devenu conseiller du Pentagone en 2016, tout en conservant un poste de président exécutif d’Alphabet, la société mère de Google.

Dans les années suivantes, Google a entamé un contrat avec le Pentagone, lui permettant d’utiliser certaines de ses technologies de reconnaissance d’images dans le cadre d’un projet militaire.

Le projet Maven utilisait l’apprentissage automatique pour distinguer les personnes et les objets dans des vidéos de drones.

« Maven était à l’époque un moyen de remplacer les yeux humains par une vision automatique pour les séquences de drones qui étaient utilisées dans les différents conflits arabes », a déclaré le Dr Schmidt. « Je considérais l’utilisation de cette technologie comme une chose positive pour la sécurité nationale et un bon partenariat pour Google. »

Du sang sur les mains

Mais le projet a reçu des critiques de la part d’employés de Google qui ont démissionné, et ont lancé une pétition contre le projet.

« Google ne devrait pas être impliqué dans le commerce de la guerre », a déclaré Laura Nolan, ingénieure logiciel qui a démissionné en 2018, lorsqu’elle a découvert la nature du projet sur lequel Google travaillait. « J’avais un peu l’impression d’avoir du sang sur les mains » a-t-elle ajouté.(([1] bbc.com/news/technology-57122120))

Elle a fait valoir que la technologie pourrait être utilisée dans de futures décisions de ciblage.

Mais Google a déclaré que son IA ne serait utilisée qu’à des fins non offensives, avant de se retirer complètement du projet Maven en juin 2018.

Le Dr Schmidt a déclaré qu’il pensait que la technologie qui pouvait aider les militaires à prendre les bonnes décisions était néanmoins une « bonne chose. »

Course à l’armement de l’IA

Mais le ministère de la Défense américain continue de chercher des partenariats dans la Silicon Valley, pour tenter de remporter la course mondiale aux armements en IA.

Seth Moulton, président du groupe de travail américain sur l’avenir de la défense, exhorte les entreprises technologiques à soutenir le ministère de la défense :

« Parce que nous sommes dans une course, nous sommes dans cette compétition. C’est vraiment de quoi il est question », a-t-il déclaré. « Va-t-on nous aider à gagner cette course ou bien va-t-on essentiellement être contre nous ? La Chine n’a pas le même système de gouvernement que nous.

La course à l’armement en matière d’IA pourrait-elle conduire à un conflit avec la Chine ? Absolument. »

Le Dr Xue reconnaît qu’il existe un potentiel de conflit :

« Mais ce n’est pas inévitable : les États-Unis et la Chine devraient vraiment collaborer pour éviter que cela ne se produise. »

En attendant ce vœu pieux chinois, Panorama a découvert des preuves « choquantes et effrayantes » selon le Daily Mail,(([2] dailymail.co.uk/sciencetech/article-9625719/Microsoft-president-Brad-Smith-warns-life-like-Orwells-1984-2024.html?ico=embedded)) montrant que la Chine utilise déjà l’IA pour surveiller sa population, y compris une technologie qui prétend être capable de « reconnaître les émotions » et de déterminer la culpabilité.

« Le documentaire se base sur des preuves apportées par un ingénieur informatique qui a déclaré anonymement, car il craint pour sa sécurité, qu’il avait aidé à installer le système dans les commissariats de police de la province du Xinjiang, qui abrite 12 millions de Ouïghours, principalement musulmans. Il a déclaré ainsi :

« Nous avons placé la caméra de détection des émotions à trois mètres du sujet. C’est similaire à un détecteur de mensonges, mais il s’agit d’une technologie beaucoup plus avancée. Elle est utilisée pour confirmer le préjugé des autorités sans aucune preuve crédible. Le score informatique révèle que le suspect est dangereux, il doit donc être coupable de nombreux actes répréhensibles qui n’ont pas encore été avoués. »

L’IA conventionnelle utilise une entrée pour « enseigner » un algorithme sur un sujet particulier en lui fournissant d’énormes quantités d’informations. Elle peut donc être utilisée à des fins néfastes, comme c’est le cas en Chine où elle tente de déterminer la culpabilité des personnes interpellées par la police. »(([3] medias-presse.info/le-president-de-microsoft-previent-la-vie-deviendra-comme-celle-de-1984-dorwell/143056/))

Si même le président de Microsoft s’inquiète des dérives totalitaires où peut mener l’intelligence artificielle, c’est qu’il y a vraiment péril en la demeure. Il est certainement mieux placé que Klaus Schwab pour comprendre le monde cauchemardesque vers lequel cela peut mener.

Traduction et adaptation : Jean-Michel Grau

⚠ Les points de vue exprimés dans l’article ne sont pas nécessairement partagés par les (autres) auteurs et contributeurs du site Nouveau Monde.

Ah bon en 2024 on sera dans un état Communiste ? Parce que 1984 c’est une critique du Communisme en fait.

Critique du communisme au travers de la représentation de ses excès et dérapages, peut-être ?