08/03/2024 (2024-03-08)

[Source : epochtimes.fr]

Par Ludovic Genin

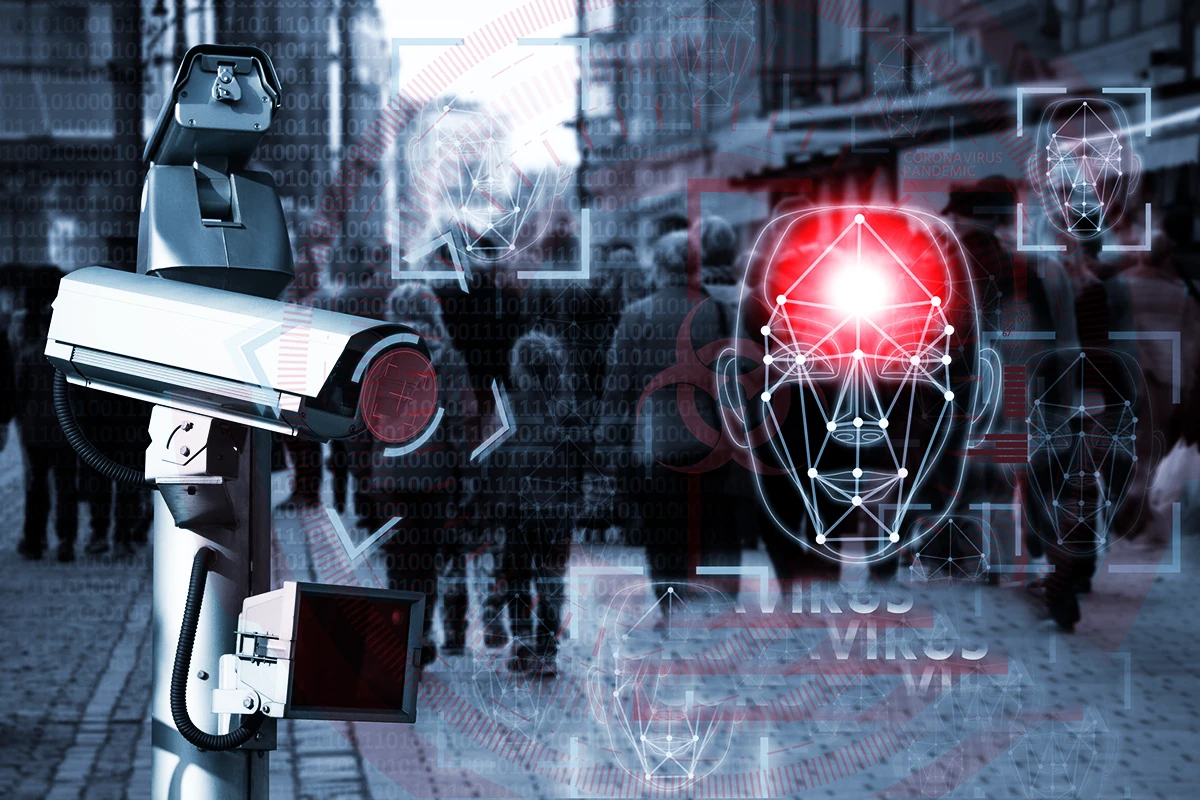

Cent ans après les derniers Jeux olympiques d’été organisés en France, ceux de Paris en 2024 ont, en effet, changé de siècle. Pour relever le défi sécuritaire, des caméras connectées à l’intelligence artificielle vont scanner les foules à la recherche de comportements anormaux.

(MARTIN BUREAU/AFP via Getty Images)

Le but, faciliter le contrôle des lieux publics par les forces de l’ordre ; le risque, une atteinte aux libertés individuelles.

Tout le monde a encore en tête le système de crédit social chinois, où une surveillance algorithmique généralisée scanne la population 24 h sur 24 pour leur attribuer une « note sociale » leur permettant (ou pas) de se déplacer, de rentrer dans des épiceries, des librairies, à l’hôpital, etc. en d’autres termes, la dictature numérique d’un régime autoritaire.

Mais, s’il faut continuer à être sur ses gardes, la France n’en est pas encore là et la vidéosurveillance pourrait aider contre la petite délinquance ou le terrorisme lors de grands événements sportifs comme les JO, si les images, bien évidement, ne sont pas détruites comme c’était le cas lors de la finale de la Ligue des champions en mai 2022.

Un outil autorisé et encadré par la loi

L’expérimentation des caméras de vidéosurveillance algorithmique a été votée et autorisée dans la loi olympique du 19 mai 2023. Les premiers tests n’ont été effectués que récemment lors des concerts du groupe Depeche Mode début mars à l’Accor Arena de Bercy.

L’article 10 de la loi olympique prévoit la possibilité de coupler les images issues des caméras de vidéosurveillance de la Préfecture de police à des algorithmes permettant de détecter automatiquement des « événements anormaux ».

Ces caméras, suppléées par l’intelligence artificielle (IA), sont autorisées à détecter huit types de situations suspectes : le non-respect du sens de circulation, le franchissement d’une zone interdite, la présence ou l’utilisation d’une arme, un départ de feu, un mouvement de foule, une personne au sol, une densité trop importante ou un colis abandonné.

La loi interdit cependant la reconnaissance faciale et le recoupement avec des fichiers judiciaires ou civils. L’IA derrière les caméras ne pourra pas, pour le moment, rechercher un individu à partir d’une banque d’images.

Un usage expérimental jusqu’en 2025

Quatre entreprises se sont partagé le budget de 8 millions d’euros alloué par le ministère de l’Intérieur pour la vidéosurveillance algorithmique des Jeux olympiques : Wintics, Videtics, Orange Business et Chapsvision.

Pour bien comprendre, ces entreprises transforment les images prises sur les vidéos en données statistiques grâce à une intelligence artificielle et l’IA pourra envoyer des alertes en temps réel aux autorités. Au ministère de l’Intérieur, on parle d’une aide numérique à la lecture des infractions et que ce sera toujours un « être humain » qui vérifiera les signalements envoyés pour décider de déclencher une réponse opérationnelle, comme l’intervention des pompiers, l’interpellation d’un suspect, l’appel de la brigade antiterroriste, etc.

Les machines, elles, n’ont pas de capacité d’analyse, il faut les calibrer avec de très nombreuses images pour qu’elles puissent reproduire l’identification d’une situation, mais la tâche est loin d’être facile.

Pour la présence ou l’utilisation d’une arme, par exemple, comment définir pour une IA ce qu’est une arme ou l’utilisation d’une arme ? Quelle est la différence entre une arme et un téléphone portable ou un parapluie ? Comment différencier une attaque sur une personne d’une embrassade ou d’une simple bousculade ? Le nombre de critères à prendre en compte est presque infini si l’on considère toutes les situations imprévues qui peuvent apparaître dans un espace public, compte tenu de la diversité des comportements humains, selon les âges, les professions et les cultures.

Chaque alerte d’une IA devra d’abord faire l’objet d’une vérification par les opérateurs privés puis par des agents des forces de l’ordre pour valider l’intervention. Il faut aussi que le calibrage ne soit ni trop large ni trop restrictif pour éviter une surinterprétation ou une sous-interprétation d’un comportement critique par l’IA.

Pour le moment, la technologie n’est pas opérationnelle et reste en phase de test. Selon, le secrétaire général de la CNIL Louis Dutheillet de Lamothe sur France Inter : « Il faut regarder si c’est utile ou pas pour sécuriser un événement, et il faut définir le bon équilibre. »

Des précautions et des besoins à prendre en compte

Le texte de loi olympique « intègre toutes les mesures indispensables au bon déroulement des Jeux […], le tout en assurant le plein respect des droits et libertés de nos concitoyens », assurait la ministre des Sports Amélie Oudéa-Castéra en avril 2023 pour défendre l’adoption de la loi. Un son de cloche identique du côté du Sénat qui dit avoir multiplié « les garde-fous, les contrôles et les garanties » selon la rapporteure LR de la loi, Agnès Canayer.

« C’est une nouvelle technologie. Il y a de la surveillance, avec l’utilisation de données, avec de l’intelligence artificielle », souligne Louis Dutheillet de Lamothe. « Le rôle de la CNIL est d’être là du début à la fin. On était là pour la réflexion sur le bon cadre de la loi (en avril 2023), pour poser les limites. »

De l’autre côté, il y a une demande des villes pour plus de vidéosurveillance devant la recrudescence de l’insécurité et notamment l’explosion des vols et des agressions. Interrogé par Mediapart, l’adjoint à la sécurité de Châteauroux — où se tiendront les épreuves de tir sportif et où les moyens de vidéosurveillance ont été renforcés en prévision des Jeux, assure que « chaque semaine, je reçois des citoyens pour parler de leur sécurité. Dans 99 % des cas, ce qu’ils me disent, c’est qu’ils veulent une caméra en bas de chez eux ou de leur commerce. »

L’expérimentation de la vidéosurveillance algorithmique doit normalement se terminer le 31 mars 2025. Elle risque cependant d’être prolongée au-delà si l’on en croit la ministre des Sports : « Si elle fait ses preuves et avec des garanties, elle pourra être utilisée pour de grands événements » précisait Amélie Oudéa-Castéra.

Il reviendra aux élus, aux associations de défense des libertés individuelles et à la CNIL de rester attentifs afin d’éviter toutes dérives d’une technologie qui pourrait être utilisée à des fins politiques, pour imposer plus de contrôle à la population.

⚠ Les points de vue exprimés dans l’article ne sont pas nécessairement partagés par les (autres) auteurs et contributeurs du site Nouveau Monde.